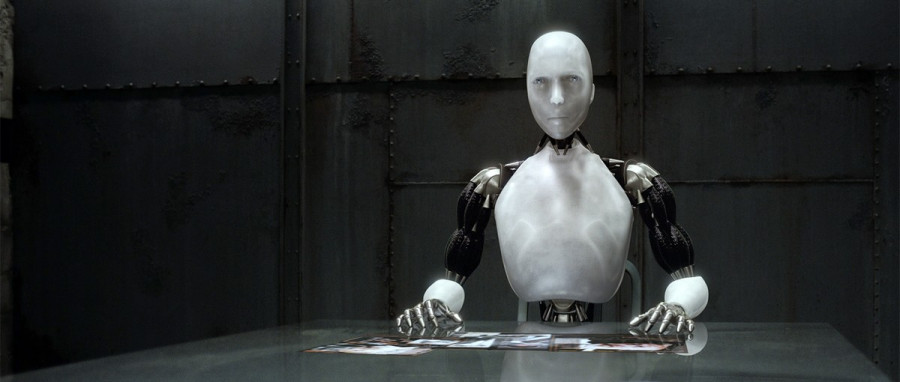

Проблема этических норм в развитии искусственного интеллекта

Евросоюз (ЕС) опубликовал набор этических руководящих принципов для создания искусственного интеллекта, который заслуживал бы доверия. Длинный список идеалистических принципов, многие из которых всё ещё технически недоступны. Они должны предотвратить любой, даже потенциальный, вред от развития технологий.

Почему это важно: пока не поздно, лучше на ранних стадиях предпринять серьёзную попытку найти общие этические принципы, которые приняли бы все страны. Но без инструмента принуждения это вряд ли приведёт к развитию безопасного ИИ. «Экспресс-Новости» узнали, что послужило проблемой и почему стало так важно найти её решение.

Общая картина

До сих пор разработка искусственного интеллекта происходила следующим образом. США предпочитают политику невмешательства, снимая с себя ответственность за деятельность Big Tech; Пекин налагает свои собственные нормы на китайские компании; Европа проложила срединный путь. Однако у всех есть растущее понимание того, что текущее развитие ИИ без присмотра движется в опасном направлении. Именно это подтолкнуло экспертов к выработке общих норм для ИИ.

Место первенства по разработке глобальной политики ИИ по-прежнему пустое. Ещё нет страны или организации, устанавливающей правила, которым будут следовать другие. Многое зависит от того, кто возьмёт на себя управление. Мир под руководством США будет сильно отличаться от мира с главенством в Китае.

«Каждый хочет диктовать свои правила» – говорит Эми Уэбб, профессор Нью-Йоркского университета и основатель Института Future Today. «ЕС выиграл преимущество первопроходца» – считает Крис Падилья, вице-президент IBM по правительственным и регуляторным вопросам. Прежде, чем правила вступят в силу, важно обратить внимание на международные стандарты и самоконтроль в отрасли разработки ИИ.

Что будет дальше

У руководства ЕС скоро будет жёсткая конкуренция. В США правительство начинает собственную разработку этических принципов. Однако все прекрасно понимают, что разработчики совсем не заинтересованы в том, чтобы следовать чьим-то рекомендациям. Развитие этики замедлит работу систем искусственного интеллекта и, возможно, сделает их менее способными.

Более того, растущий набор предложений по этике может вызвать проблемы. Фирма, выбирающая между несколькими международными руководящими принципами, национальной политикой своей страны и рекомендациями университетов и некоммерческих организаций, может в конечном итоге ничего не делать. И в таком случае проблема так и останется нерешённой.